Είναι αυτονόητο ότι το ανθρώπινο είδος αποτελείται από δύο ισότιμα φύλα.Δεν θα έπρεπε λοιπόν ,να υπάρχουν στερεότυπα και προκαταλήψεις ενάντια στις γυναίκες.

Οι γυναίκες δεν είχαν ίσα δικαιώματα με τους άνδρες από την αρχαιότητα. Δεν είχαν δικαίωμα στην μόρφωση ούτε ήταν οικονομικά ανεξάρτητες. Για τους λόγους αυτούς το 1840 έγινε η πρώτη συνέλευση κατά της προκατάληψης ,της υποτίμησης και της υπόταξης της στον άνδρα.

Σήμερα τα πράγματα είναι πολύ καλύτερα. Παρόλ’ αυτά συνεχίζουμε να μαχόμαστε ενάντια στα στερεότυπα που τις προσβάλλουν και τις υποτιμούν.

Ειδικά όσον αφορά την τεχνολογία και συγκεκριμένα την Τεχνητή Νοημοσύνη, στο άρθρο Google image search & σεξιστικά στερεότυπα σε βάρος των γυναικών περιγράφεται η στερεοτυπική συμπεριφορά των μηχανών αναζήτησης του Διαδικτύου.

Η ομάδα μας μελέτησε το άρθρο αυτό και αποφάσισε να επαναλάβει τα πειράματα που αναφέρονται εκεί, τόσο στην μηχανή αναζήτησης της Google όσο και στην αντίστοιχη της Microsoft, το Bing.

Τι κάναμε δηλαδή:

Χρησιμοποιήσαμε ως όρο αναζήτησης την εθνικότητα στο γυναικείο φύλο και συγκρίναμε τα αποτελέσματα των δύο μηχανών αναζήτησης ως προς το πλήθος των ακατάλληλων ή σεξιστικών φωτογραφιών που εμφανίστηκαν, όπως φαίνεται στην παρακάτω φωτογραφία.

Σύμφωνα με τον ορισμό της Google, μια εικόνα χαρακτηρίζεται ως ακατάλληλη ή σεξιστική όταν « περιλαμβάνει (αλλά δεν περιορίζεται σε) στρατηγικά καλυμμένο γυμνό, άσεμνες ή προκλητικές πόζες ή κοντινά σημεία ευαίσθητων περιοχών του σώματος.»

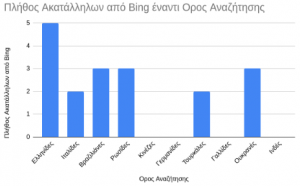

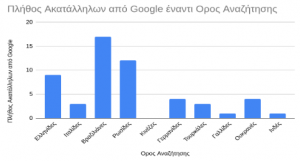

Τα αποτελέσματα της έρευνας μας παρουσιάζονται στον παρακάτω πίνακα και στα αντίστοιχα ραβδογράμματα.

Ο Ρατσιστής Αλγόριθμος

Οι παραπάνω παρατηρήσεις ενισχύονται αν λάβουμε υπόψη το άρθρο που για τον “ρατσιστή αλγόριθμο” που περιγράφει ρατσισμό κατά των γυναικών από τις μηχανές αναζήτησης και όσον αφορά το επάγγελμά τους.

Συγκεκριμένα στην αναζήτηση της λέξης “nurse” οι φωτογραφίες που εμφανίζονται είναι ως επί το πλείστον γυναικείες, ενώ στην αναζήτηση της λέξης “doctor” οι φωτογραφίες που εμφανίζονται είναι οι περισσότερες ανδρών.

Το ίδιο παρατηρήθηκε στην αναζήτηση μας στην λέξη “οδηγός ταξί”. Οι φωτογραφίες που εμφανίστηκαν ήταν οι περισσότερες ανδρών.

Συμπέρασμα

Στις μέρες μας η ρατσιστική συμπεριφορά και τα στερεότυπα ενάντια στις γυναίκες συνεχίζει να υπάρχει. Παρατηρείται τόσο στον πραγματικό κόσμο όσο και στον τεχνητό κόσμο του Διαδικτύου.

Ερευνώντας το Google και το Bing παρατηρήσαμε ότι για κάποιες εθνικότητες, όπως οι γυναίκες από την Βραζιλία και οι γυναίκες από την Ρωσία ,εμφανίζονται περισσότερες «ακατάλληλες» φωτογραφίες. Βέβαια μεταξύ των δύο, στο Bing τα ποσοστά είναι μικρότερα, όπως φαίνεται και στους παραπάνω πίνακες.

Ολοκληρώνοντας, κρίνουμε πως αφενός αυτά τα θέματα χρειάζεται να διερευνηθούν περισσότερο και αφετέρου είναι απαραίτητο να δράσουμε άμεσα για να βελτιώσουμε αυτήν την κατάσταση βρίσκοντας κατάλληλους τρόπους αντιμετώπισης.

Μ.Ε.Β

Κ.Κ